AIが生成した? イベント名や架空の企業名を騙る巧妙なフィッシングサイトの危険性

はじめに

「GitHub Copilot」や「Cline」、「Cursor」といった開発を高速化するためのAIサービスが注目を集めています。一方で、開発者だけでなく、攻撃者もAIサービスを活用しています。

今回は、攻撃者によるAI活用事例として、AIによって生成されたと思われる画像やコンテンツが用いられたフィッシングサイトの事例を紹介します。

架空の企業ロゴが並ぶ

架空のセキュリティ企業のWebページ

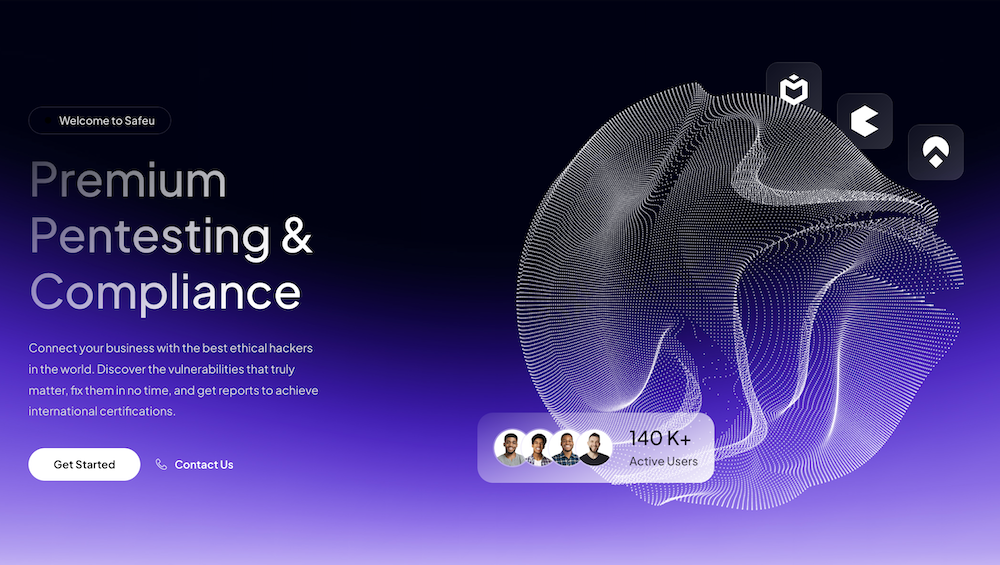

そのフィッシングサイトは、かつて「safeu.io」というドメインで公開されていました。一見すると、セキュリティソリューションを提供する企業のコーポレートサイトのように見えます。

Webサイトのデザイン自体は、現代的で洗練された印象を受けます。製品紹介や企業情報などももっともらしく配置されており、一見しただけでは不審なWebサイトだと見抜くのは難しいかもしれません。

このサイトには、いくつか不審な点が見受けられました。特に注目すべきは「コンテンツの生成にAIが利用された可能性が高い」という点です。

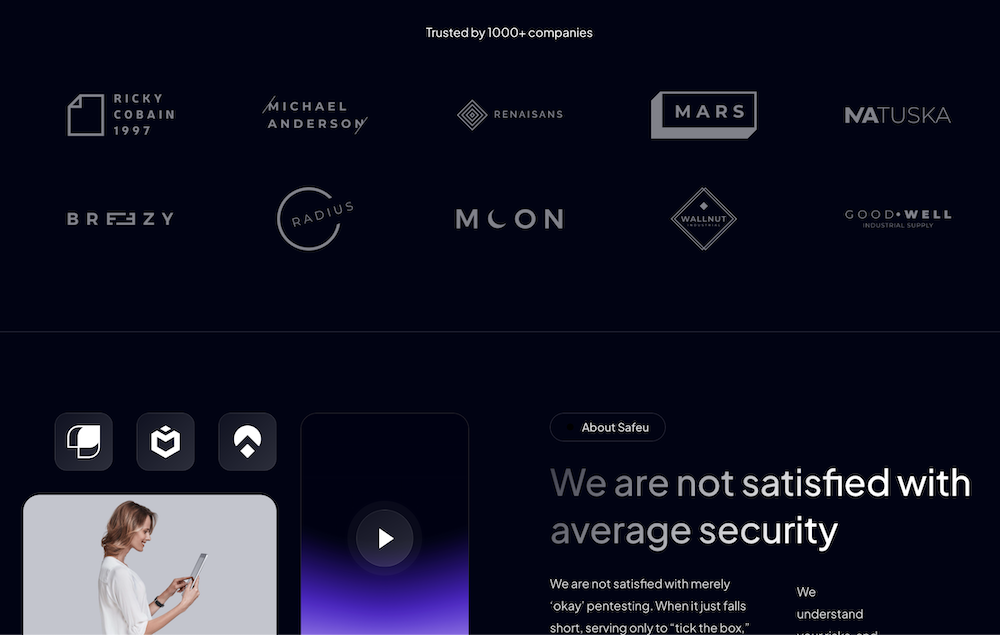

存在しない「顧客企業」のロゴ

サイト内には「Trusted by」として複数の顧客企業のロゴが掲載されていました。しかし、これらの企業名を検索しても、実在が確認できないものばかりでした。攻撃者はAIを用いて架空の企業ロゴを大量に生成し、サイトの信頼性を偽装しようとしたと考えられます。

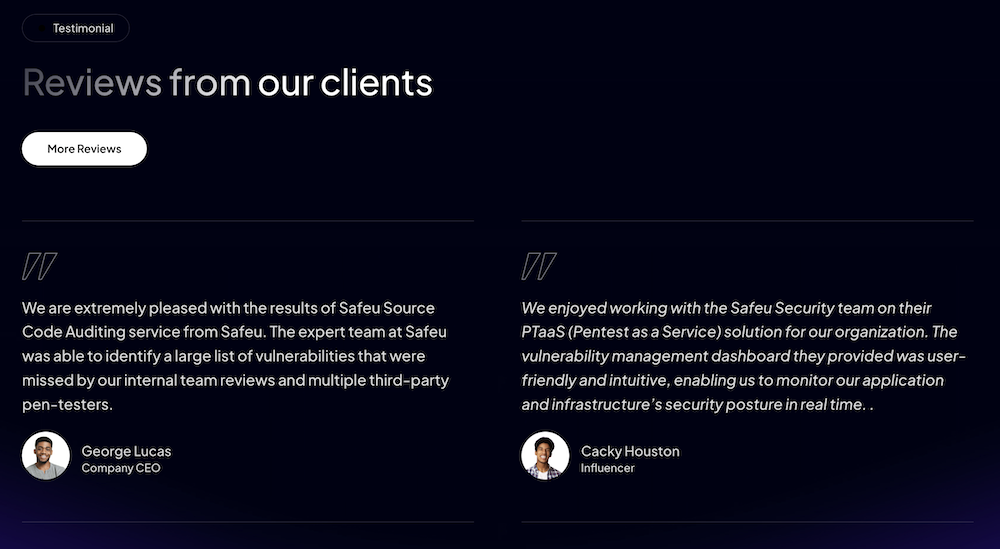

不自然な「顧客の声」の人物画像と著名人の名前

「Testimonials」(顧客の声)には、複数の人物写真と推薦文が掲載されていました。しかし、これらの人物写真には不自然にぼかされている部分があったり、顔の細部にAI生成画像特有の不自然さが見られたりするものが含まれていました。

さらに驚くべきことに、顧客の1人として映画監督の「George Lucas」氏の名前が使用されていました。もちろん、本人がこのサービスを推薦している訳ではなく、攻撃者が安易に著名人の名前を借用したか、あるいはAIが学習データに基づいて自動生成した結果、偶然(あるいは意図的に)著名人の名前が使用された可能性も否定できません。これは、サイトの信憑性を疑わせる大きな要因の1つです。

過去に企業が利用したドメインの再利用

「safeu.io」というドメインは、過去に全く別の企業が使用していたドメインでした。攻撃者は閉鎖されて利用可能になったドメインを取得し、フィッシングサイトを構築したと考えられます。

過去のドメインの運用実績によっては、新しいドメインよりも検索エンジンやセキュリティ製品の評価が甘くなる場合があり、検知を回避しやすくなるという利点があります。

このドメインを用いて「発見したリスクが高い脆弱性の情報と引き換えに、報奨金を要求する」という旨のフィッシングメールが発信されていることを確認しています。もちろん、真っ当なセキュリティ企業は、このような内容のメールを送信しません。

パリ五輪に乗じて

ICOをテーマにしたフィッシングサイトが急増

もう1つ事例を紹介します。

2024年に開催されたパリ五輪の際には、ICOをテーマにしたフィッシングサイトが急増しました。攻撃者はAI技術を使って偽のウェブサイトやSNSアカウントを自動生成し、投資家を巧みに騙して資金を不正に取得しようとしました。

この詐欺の特徴は、AIにより生成されたコンテンツが非常にリアルで、オリンピック関連のコンテンツを使って信憑性を高めている点です。生成AIを使うことで詐欺のクオリティが上がり、企業にとっては運営しているサービスの信頼を損ねるリスクが高まっています。

【参照】ICO Scams Leverage 2024 Olympics to Lure Victims, Use AI for Fake Sites

https://www.trendmicro.com/en_us/research/24/f/ico-scams-leverage-2024-olympics-to-lure-victims-use-ai-for-fake.html(Trend Micro 2024/7/27)

なぜ攻撃者はAIを活用するのか

攻撃者がフィッシングサイトの作成にAIを活用する背景には、いくつかの理由が考えられます。

制作の効率化と低コスト化

AIを利用することでWebサイトのデザイン、ロゴ、紹介文、さらには顧客の声といったコンテンツを短時間で大量に、かつ低コストで生成できます。特に自然言語、つまり普段生活するのに使用している言語で操作できるため、技術力が低い攻撃者でもAIを活用して大量のフィッシングメールや偽サイトを短時間で生成し、ターゲットに送りつけることができます。

これにより、攻撃のコストが大幅に削減され、効率的に大規模な攻撃を展開することが可能となりました。

ソーシャルエンジニアリングへの活用

生成AIを活用することで、攻撃者は特定の個人や企業に合わせたカスタマイズコンテンツを簡単に生成できます。例えば、SNS上でターゲットの趣味や関心を分析し、そのデータに基づいて信頼性の高いコンテンツを生成することが可能です。

これにより、SNSプロフィールや日々の投稿内容まで標的に合わせて作成され、攻撃の信頼性が高まります。個々のターゲットに合わせたフィッシング攻撃がより高度に進化し、私たちが日常的に利用しているSNSやメールが悪用されるリスクが高まっています。

フィッシング攻撃とはベクトルがやや異なる事例ですが、AIを用いて偽情報を生成し、民衆の分断を助長した事例があります。

2024年アメリカ合衆国大統領選挙においては、選挙結果に影響を与えるための5,000以上にもおよぶX(旧Twitter)アカウントで構成されたネットワーク「Green Cicada Network」が発見されました。このネットワークは主にアメリカの偽の政治問題を拡散し、選挙に影響を与える目的で運用されていました。

【参照】CyberCX Unmasks China-linked AI Disinformation Capability on X

https://cybercx.com.au/blog/cybercx-unmasks-china-linked-ai-disinformation-capability/(CyberCX 2024/8/13)

AIが生成したコンテンツを通じて大規模な偽情報を拡散し、民衆の分断を助長することは既に可能となっています。

このように、生成AIを使った情報操作や偽情報の拡散は、私たちの社会に深刻な影響を与え得る大きなリスクです。

言語の壁を乗り越える

従来のフィッシングメールは、不自然な日本語を含むことも多かったです。生成AIの登場により、攻撃者は精度の高い自然な言語でフィッシングメールを生成できるようになり、言語の壁を越えた攻撃が容易になっています。

AIは人間が書いたものと区別がつかない自然な文章を生成するため、標的の言語や文化に関係なく効果的な攻撃を仕掛けることができます。

私たちが注意すべきこと

このようなAIを活用したフィッシングサイトの脅威に対抗するためには、私たち自身が用心深く、情報を判断するリテラシーを身につけることが重要です。少しでも不審な点を感じたら、企業名や担当者名を検索したり、ドメイン情報を確認したりするなど、情報の真偽を多角的に確認する癖をつけましょう。

また、AIが生成した画像には、細部に不自然な点が残っている場合があります。特に人物の指の形状や背景の不自然さにも注目してみましょう。初めて利用するサイトや少しでも疑わしいと感じたサイトでは、安易にID、パスワード、クレジットカード情報などの個人情報を入力しないようにしましょう。

おわりに

今回は、攻撃者がフィッシングサイトの開発に生成AIを活用し、特にAIによって生成された画像を用いる手口に焦点を当てて解説しました。今回紹介した「safeu.io」の事例は攻撃者がAIを悪用して、いかに「もっともらしい」偽の情報を生成し、ユーザーを騙そうとしているかを示す好例と言えるでしょう。

開発ツールとしてのAIの恩恵はありがたいものですが、その力が攻撃者の手に渡ることで、私たちユーザーはより巧妙化する脅威に晒されることになります。

AIが悪用される現状を理解し、冷静に情報を判断するリテラシーを身につけることが、私たち自身を守るための最も有効な手段と言えるでしょう。

連載バックナンバー

Think ITメルマガ会員登録受付中

全文検索エンジンによるおすすめ記事

- 【注目】パリ五輪に学ぶ、生成AIの進化と課題

- MailGuard、Dropboxを騙るフィッシングメールに関して注意喚起

- MailGuard、Dropboxを騙るフィッシングメールに関して注意喚起

- Bleeping Computer、Office 365のアカウント情報を窃取するフィッシングキャンペーンについて注意喚起を発表

- Webサービスをローンチする前に見ておきたいチェックリスト

- MailGuard、新しいタイプのフィッシングメールについて注意喚起

- 低コスト高品質サーバでサイト構築&再販を手がけるマーカーネット

- ソニーのXRヘッドセットがついに発売/イベントでApple Vision Pro作品が展示

- グッドラックスリー社長とプロデューサーが語るブロックチェーンを活用した新しいメディアとは

- フィッシング対策協議会、新型コロナワクチン接種の予約を装うフィッシングについて注意喚起を発表